گروه جامعه و اقتصاد «سدید»؛ «جان بیلی» [1] مشاور استراتژیک در امور کارآفرینی و سیاستگذاری و کارشناس ارشد غیرمقیم در مؤسسه «American Enterprise» در یادداشتی که وبسایت مجله تخصصی «Education Next» آن را منتشر کرده است به موضوع فرصتها و چالشهای استفاده از هوش مصنوعی در مدارس برای آموزش کودکان میپردازد. او تأکید میکند که با توجه به فرصتهای بسیاری که هوش مصنوعی در امر آموزش ایجاد میکند گریزی از استفادة آن در مدارس نیست؛ اما هوش مصنوعی نمیتواند جایگزین یک معلم شود و باید حتماً عاملیت و نظارت انسانی برای به حداقل رساندن مضرات استفاده از آن حفظ شود.

جهش بزرگ در هوش مصنوعی

در رمان علمی - تخیلی «نیل استفنسون» [2] که در سال ۱۹۹۵ تحت عنوان «عصر الماس» [3] منتشر شد، خوانندگان با «نل»، دختر جوانی آشنا میشوند که کتاب بسیار پیشرفتهای در اختیار دارد. کتاب، یک مجموعة ایستای معمول حاوی متون و تصاویر نیست، بلکه یک ابزار عمیقاً فراگیر است که میتواند با خواننده صحبت کند و به سؤالاتش پاسخ دهد. همه اینها در خدمت آموزش و ایجاد انگیزه یک دختر جوان برای تبدیلشدن به فردی قوی و مستقل است.

چنین وسیلهای حتی پس از معرفی اینترنت و رایانههای تبلت، تاکنون در قلمرو داستانهای علمی تخیلی باقی مانده است. هوش مصنوعی با معرفی «ChatGPT» در نوامبر ۲۰۲۲، یک فناوری که قادر به تولید پاسخهای خلاقانه و تجزیه و تحلیل پیچیده از طریق گفتوگوهای انسانمانند است، جهش بزرگی رو به جلو داشت. این کار موجی از نوآوری را به راه انداخته است که برخی از آنها نشان میدهد ممکن است در آستانه عصر ابزارهای تعاملی و فوق هوشمندی باشیم که با کتابی که «استیفنسون» برای «نل» در نظر گرفته بود بیشباهت نیست. «ساندار پیچای» [4]، مدیرعامل گوگل، هوش مصنوعی را «عمیقتر از آتش یا برق یا هر کاری که در گذشته انجام دادهایم» میداند. «رید هافمن» [5]، مؤسس «لینکدین» میگوید: «قدرت ایجاد تغییرات مثبت در جهان در شرف دریافت بزرگترین تقویتی است که تا به حال داشته است.» «بیل گیتس» [6] هم گفته است که «این موج جدید هوش مصنوعی به اندازه ایجاد ریزپردازنده، رایانه شخصی، اینترنت و تلفن همراه اساسی است.»

خطاپذیری در استفاده از هوش مصنوعی اجتناب ناپذیر است، به همین دلیل حفظ نظارت دقیق انسانی بر خروجی هوش مصنوعی اهمیتی حیاتی دارد.

در سال گذشته توسعهدهندگان، مجموعهای خیرهکننده از ابزارهای هوش مصنوعی را منتشر کردند که میتواند متن، تصاویر، موسیقی و ویدئو را بدون نیاز به کدنویسی پیچیده، بلکه در پاسخ به دستورالعملهای ارائهشده به زبان طبیعی تولید کند. این فناوریها بهسرعت در حال بهبود و ارتقا هستند و توسعهدهندگان، قابلیتهایی را معرفی میکنند که همین چند سال پیش بهعنوان مسئلهای علمی - تخیلی در نظر گرفته میشد. توسعة هوش مصنوعی همچنین سؤالات اخلاقی اساسی و حساسی را در مورد سوگیری، استفاده مناسب و سرقت ادبی به دنبال داشته است.

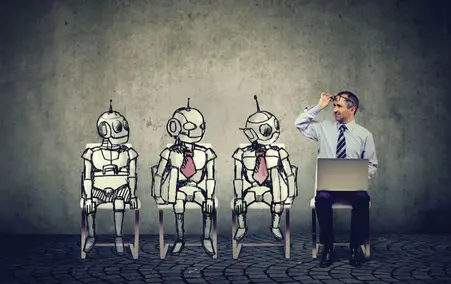

در حوزه آموزش، این فناوری بر نحوه یادگیری دانشآموزان، نحوه کار معلمان و در نهایت نحوه ساختار سیستم آموزشی ما تأثیر میگذارد. برخی از مربیان با اشتیاق فراوان منتظر این تغییرات هستند. «سال خان» [7]، بنیانگذار آکادمی «خان»، تا جایی پیش رفت که در یک سخنرانی گفت: هوش مصنوعی این پتانسیل را دارد که «احتمالاً بزرگترین تحول مثبتی باشد که آموزشوپرورش تا به حال به خود دیده است». اما برخی دیگر هشدار میدهند که هوش مصنوعی امکان انتشار اطلاعات نادرست را فراهم میکند، تقلب را در مدرسه و دانشگاه تسهیل میکند، تمام حریم خصوصی افراد را از بین میبرد و باعث از دست دادن گسترده شغل افراد میشود. چالش این است که از ظرفیت مثبت هوش مصنوعی در عین اجتناب از آسیبهای آن استفاده کنیم.

هوش مصنوعی مولد چیست؟

هوش مصنوعی شاخهای از علم رایانه است که بر ایجاد نرمافزاری با قابلیت تقلید رفتارها و فرایندهای هوشمند انسانی مثل استدلال، یادگیری، حل مسئله و اعمال خلاقیت تمرکز دارد. سیستمهای هوش مصنوعی را میتوان برای طیف گستردهای از وظایف، از جمله ترجمه زبان، تشخیص تصویر، پیمایش وسایل نقلیه خودران، تشخیص و درمان سرطان و در مورد هوش مصنوعی مولد، تولید محتوا و دانش به جای جستجو و بازیابی ساده آن به کار برد. «مدلهای بنیادی» در هوش مصنوعی مولد، سیستمهایی هستند که بر روی یک مجموعه دادههای بزرگ، سوار شدهاند تا حجم وسیعی از دانش را بیاموزند و سپس میتواند با طیفی از اهداف مختلف و خاصتر سازگار شود. این روش، نامش یادگیری خود نظارتی است؛ به این معنی که مدل با یافتن الگوها و روابط در دادههایی که بر روی آنها آموزش دیده است، یاد میگیرد.

مدلهای زبان بزرگ (LLM) مدلهای پایهای هستند که بر روی حجم وسیعی از دادههای متنی آموزش دیدهاند. برای مثال دادههای آموزشی برای شبکه پردازش زبان طبیعی شرکت «OpenAI» شامل محتوای وب، کتابها، مقالات ویکیپدیا، مقالات خبری، پستهای رسانههای اجتماعی و موارد دیگر است. مدلهای زبانی بزرگ (LLM) شرکت «OpenAI» با تجزیه و تحلیل در میان میلیاردها جمله، یک درک آماری از زبان ایجاد میکنند. معمولاً این که چگونه کلمات و عبارات ترکیب میشوند، چه موضوعاتی با هم مقایسه میشوند و چه لحن یا سبکی در زمینههای مختلف مناسب است، نحوه کار هوش مصنوعی است. این کار به او اجازه میدهد تا متنی شبیه به انسان تولید کند و طیف گستردهای از وظایف مانند نوشتن مقاله، پاسخ به سؤالات یا تجزیه و تحلیل دادههای بدون ساختار را انجام دهد. از معروفترین این برنامههای کاربردی در این زمینه میتوان به موارد زیر اشاره کرد: «ChatGPT 3.5»، «ChatGPT 4.0»، «Microsoft Bing Chat»، «Google Bard»، «Anthropic Claude 2»

هنگامی که دانشآموزان یا مربیان با ابزارهای مولد هوش مصنوعی تعامل دارند، مکالمات و اطلاعات شخصی آنها ممکن است ذخیره و تجزیه و تحلیل شود و حریم خصوصی آنها را به خطر بیندازد.

سیستمهای هوش مصنوعی با سرعت قابلتوجهی در حال ارتقا و بهبود هستند. بهعنوانمثال «ChatGPT 3.5» که در مارس ۲۰۲۲ توسط شرکت «OpenAI» منتشر شد، در آزمون وکالت توانست نمره ۱۰ از ۱۰۰ را کسب کند اما «GPT-4.0» که یک سال بعد معرفی شد، جهش قابلتوجهی داشت و ۹۰ امتیاز کسب کرد. چیزی که این شاهکارها را چشمگیر میکند این است که «OpenAI» به طور خاص سیستمی را برای شرکت در این امتحانات آموزش نداده است؛ یعنی هوش مصنوعی توانسته است به تنهایی به پاسخهای صحیح برسد. به طور مشابه، مدل «هوش مصنوعی پزشکی گوگل» عملکرد خود را در آزمون آزمایشی مجوز پزشکی ایالات متحده به طور قابل توجهی بهبود بخشید و نرخ دقت آن از ۳۳ درصد در دسامبر ۲۰۲۰ به ۸۵ درصد در مارس ۲۰۲۱ افزایش یافت. این دو مثال فرد را بر آن میدارد که بپرسد: اگر هوش مصنوعی به این سرعت به بهبود خود ادامه دهد، این سیستمها در چند سال آینده قادر به دستیابی به چه چیزی خواهند بود؟ علاوه بر این، مطالعات جدید این فرضیه را به چالش میکشد که پاسخهای تولید شده توسط هوش مصنوعی کهنه یا عقیم و بیهوده هستند.

در مورد مدل هوش مصنوعی گوگل، پزشکان پاسخهای طولانی هوش مصنوعی را به پاسخهایی که توسط پزشکان همکارشان نوشته شده بودند ترجیح دادند و شرکتکنندگان در مطالعه غیرپزشکی پاسخهای هوش مصنوعی را مفیدتر ارزیابی کردند. یک مطالعه دیگر نشان داد که شرکتکنندگان پاسخهای یک ربات چت پزشکی را بر پاسخهای یک پزشک ترجیح میدهند و آنها را نهتنها از نظر کیفیت، بلکه از نظر همدلی نیز به طور قابلتوجهی بالاتر ارزیابی کردند. وقتی از هوش مصنوعی بهصورت «همدلانه» در آموزش استفاده شود چه اتفاقی خواهد افتاد؟

مطالعات دیگر به قابلیتهای استدلالی این مدلها پرداختهاند. محققان مایکروسافت اظهار میکنند که سیستمهای جدیدتر «هوش عمومی بیشتری نسبت به مدلهای قبلی هوش مصنوعی از خود نشان میدهند» و «به طور قابلتوجهی به عملکرد در سطح انسانی نزدیک میشوند». در حالی که برخی از ناظران این نتیجهگیریها را زیر سؤال میبرند، سیستمهای هوش مصنوعی توانایی فزایندهای برای تولید پاسخهای منسجم و متناظر مناسب، ایجاد ارتباط بین قطعات مختلف اطلاعات و شرکت در فرایندهای استدلالی مانند استنتاج و قیاس از خود نشان میدهند.

این سیستمها با وجود قابلیتهای شگرف اما خالی از ایراد هم نیستند. گاهی اوقات، آنها اطلاعاتی را به دست میآورند که ممکن است قانعکننده به نظر برسد، اما نامربوط، غیرمنطقی یا کاملاً نادرست باشند. اجرای برخی عملیاتهای ریاضی، حوزه دیگری از دشواری را برای هوش مصنوعی به همراه دارد و در حالی که این سیستمها میتوانند متنی درست و واقعی تولید کنند، درک اینکه چرا مدل تصمیمها یا پیشبینیهای خاصی صورت گرفته است، میتواند چالشبرانگیز باشد.

اهمیت اعلانهای خوب طراحی شده

استفاده از سیستمهای هوش مصنوعی مولد مانند «ChatGPT»، «Bard» و «Claude 2» نسبتاً ساده است. فقط باید یک درخواست یا یک کار (به نام اعلان) را تایپ کنید و هوش مصنوعی پاسخی را ایجاد کند. اعلانهای درست ساخته شده برای بهدستآوردن نتایج مفید از ابزارهای هوش مصنوعی مولد ضروری هستند. شما میتوانید از هوش مصنوعی مولد بخواهید که متن را تجزیه و تحلیل کند، الگوها را در دادهها بیابد، استدلالهای مخالف را مقایسه کند و یک مقاله را به روشهای مختلف خلاصه کند. یکی از چالشها این است که پس از سالها استفاده از موتورهای جستجو، افراد به شیوهای خاص به بیان سؤالات میپردازند. یک موتور جستجو چیزی شبیه یک کتابدار مفید است که یک سؤال خاص را مطرح میکند و شما را به مرتبطترین منابع برای پاسخهای ممکن راهنمایی میکند. موتور جستجو (یا کتابدار) هیچ چیز جدیدی ایجاد نمیکند، اما به طور مؤثر آنچه را که قبلاً وجود دارد، بازیابی میکند. هوش مصنوعی مولد بیشتر شبیه یک کارآموز شایسته است. شما دستورالعملهای ابزار هوش مصنوعی مولد را از طریق اعلانها ارائه میدهید - همانطور که به یک کارآموز میدهید - و از او میخواهید که یک کار را تکمیل کند و یک محصول تولید کند. هوش مصنوعی، دستورهای شما را تفسیر میکند، در مورد بهترین راه برای انجام آنها فکر میکند و چیزی تولید میکند یا وظیفهای را برای انجام دستور شما انجام میدهد. نتایج از پیش ساخته، در جایی ذخیره نمیشوند، بلکه بر اساس اطلاعاتی که کارآموز (هوش مصنوعی مولد) روی آنها آموزش دیده است، بهسرعت تولید میشوند.

این خطر وجود دارد که اختصاص زمان بیشتر برای استفاده از سیستمهای هوش مصنوعی به قیمت تعامل کمتر دانشآموز با مربیان و همکلاسیها تمام شود.

خروجی اغلب به دقت و وضوح دستورالعملهایی که ارائه میکنید بستگی دارد. یک درخواست مبهم یا ضعیف ممکن است باعث شود هوش مصنوعی نتایج مرتبط کمتری تولید کند. هرچه زمینه و جهت بیشتری به آن بدهید، نتیجه بهتری خواهد داشت. علاوه بر این، قابلیتهای این سیستم هوش مصنوعی از طریق معرفی پلاگینهای متنوعی که آنها را برای مرور وبسایتها، تجزیه و تحلیل فایلهای داده یا دسترسی به خدمات دیگر مجهز میکند، افزایش مییابد. یک استراتژی در استفاده از ابزار مولد هوش مصنوعی این است که ابتدا به آن بگویید که میخواهید چه نوع متخصص یا شخصیتی باشد. سپس از آن بخواهید که یک مشاور مدیریت خبره، یک معلم ماهر، یک معلم نویسندگی یا یک ویرایشگر متن باشد و سپس به آن وظیفه بدهید.

همچنین میتوان برای وادارکردن این سیستمهای هوش مصنوعی به انجام عملیات پیچیده و چندمرحلهای، دستورهایی ایجاد کرد. برای مثال فرض کنید معلمی میخواهد یک برنامه آموزشی تطبیقی ایجاد کند - برای هر موضوعی، هر کلاسی، در هر زبانی - که مثالها را بر اساس علایق دانشآموزان سفارشی میکند. او میخواهد هر درس به یک پاسخ کوتاه یا چندگزینهای ختم شود. اگر دانشآموز به سؤالات پاسخ صحیح بدهد، معلم هوش مصنوعی باید به سراغ درس بعدی برود و اگر دانشآموز پاسخ نادرستی بدهد، هوش مصنوعی باید دوباره مفهوم را توضیح دهد، اما از زبان سادهتری استفاده کند.

با این حال، درست مانند کارآموزان تازه کار، هوش مصنوعی نیز گاهی مرتکب خطا میشود. چنین خطاپذیری، اگرچه اجتناب ناپذیر است اما بر اهمیت حیاتی حفظ نظارت دقیق انسانی بر خروجی هوش مصنوعی تأکید میکند. نظارت نه تنها به عنوان یک ایست بازرسی مهم برای افزایش دقت عمل میکند بلکه به یک منبع حیاتی بازخورد برای سیستم تبدیل میشود. از طریق این فرایند اصلاح مکرر است که یک سیستم هوش مصنوعی، در طول زمان میتواند به طور قابلتوجهی میزان خطای خود را به حداقل برساند و کارایی آن را افزایش دهد.

کاربردهای هوش مصنوعی در آموزش

در می ۲۰۲۳، وزارت آموزش ایالات متحده گزارشی با عنوان «هوش مصنوعی و آینده آموزش و یادگیری: بینشها و توصیهها» منتشر کرد. این وزارتخانه در سال ۲۰۲۲ جلسات استماع را با بیش از ۷۰۰ نفر از جمله مربیان و والدین برگزار کرده بود تا نظرات آنها را در مورد هوش مصنوعی ارزیابی کند. در این گزارش اشاره شده است که «نویسندگان بر این باورند که اکنون برای پیشی گرفتن از توسعه مورد انتظار هوش مصنوعی در فناوری آموزشی، اقدامی لازم است و آنها میخواهند آستینها را بالا بزنند و با هم کار کنند.» مردم درباره «خطرات احتمالی آینده» درباره هوش مصنوعی ابراز نگرانی کردند، اما همچنین احساس کردند که «هوش مصنوعی ممکن است امکان دستیابی به اولویتهای آموزشی را به روشهای بهتر، در مقیاس و با هزینههای کمتر فراهم کند».

هوش مصنوعی میتواند در چندین نقش آموزشی و یادگیری خدمت کند یا در حال حاضر در حال خدمت است:

- دستیاران آموزشی

توانایی هوش مصنوعی در انجام مکالمات شبیه به انسان، امکانی را برای آموزش تطبیقی یا دستیاران آموزشی فراهم میکند که میتواند به توضیح مفاهیم دشوار برای دانشآموزان کمک کند. سیستمهای بازخورد مبتنی بر هوش مصنوعی میتوانند نقدهای سازندهای در مورد نوشتن دانشآموزان ارائه دهند که این میتواند به دانشآموزان کمک کند تا مهارتهای نوشتاری خود را به خوبی تنظیم کنند. همچنین برخی تحقیقات نشان میدهند که انواع خاصی از اعلانها میتوانند به کودکان کمک کنند تا سؤالات پربارتری در مورد یادگیری ارائه بدهند. مدلهای هوش مصنوعی همچنین ممکن است از یادگیری سفارشی برای دانشآموزان دارای معلولیت پشتیبانی کنند و برای زبانآموزان انگلیسی، ترجمه ارائه دهند.

- دستیاران معلم

هوش مصنوعی ممکن است برخی از وظایف اداری را که معلمان را از سرمایهگذاری زمان بیشتری با همسالان یا دانشآموزان خود باز میدارد، برطرف کند. کاربردهای اولیه شامل کارهای روزانه مانند تهیه پیشنویس طرح درس، ایجاد مطالب متمایز، طراحی کاربرگها، توسعه آزمونها و بررسی راههای مختلف توضیح مطالب پیچیده علمی است. هوش مصنوعی همچنین میتواند توصیههایی برای رفع نیازهای دانشآموزان در اختیار مربیان قرار دهد و به معلمان در تفکر، برنامهریزی و بهبود عملکرد آنها کمک کند.

- دستیاران والدین

والدین میتوانند از هوش مصنوعی برای تولید نامههای درخواست خدمات برنامه آموزشی فردی (IEP) یا درخواست ارزیابی کودک خود استفاده کنند. برای والدینی که مدرسه را برای فرزند خود انتخاب میکنند، هوش مصنوعی میتواند به عنوان یک دستیار اداری عمل کند، برنامههای مدرسه را در فاصله رانندگی از خانه ترسیم کند، جدول زمانی برنامهها را ایجاد کند و اطلاعات تماس و غیره را گردآوری کند. هوش مصنوعی مولد حتی میتواند داستانهای قبل از خواب را با طرحهای در حال تکامل متناسب با علایق کودک ایجاد کند.

- دستیاران مدیر

با استفاده از هوش مصنوعی مولد، مدیران مدارس میتوانند ارتباطات مختلفی از جمله مطالبی برای والدین، خبرنامهها و سایر اسناد مشارکت اجتماعی تهیه کنند. سیستمهای هوش مصنوعی همچنین میتوانند به وظایف دشوار سازماندهی برنامههای کلاس یا اتوبوس مدرسه کمک کنند و دادههای پیچیده را برای شناسایی الگوها یا نیازها تجزیه و تحلیل کنند. «ChatGPT» میتواند تجزیه و تحلیل احساسات پیچیدهای را انجام دهد که میتواند برای اندازهگیری آبوهوای مدرسه و دیگر دادههای نظرسنجی مفید باشد.

اگرچه پتانسیل فوقالعادهای است، اما بیشتر معلمان هنوز از این ابزارها استفاده نمیکنند. یک نظرسنجی نشان میدهد در حالی که ۶۰ درصد معلمان میگویند که در مورد «ChatGPT» شنیدهاند اما تنها ۱۴ درصد از آن در اوقات فراغت خود استفاده کردهاند و تنها ۱۳ درصد از آن در مدرسه استفاده کردهاند. این احتمال وجود دارد که بیشتر معلمان و دانشآموزان با هوش مصنوعی مولد نه از طریق خود پلتفرمها بلکه از طریق قابلیتهای هوش مصنوعی تعبیه شده در نرمافزار درگیر شوند.

هم معلمان و هم دانشآموزان با خطر وابستگی بیش از حد به فناوری مبتنی بر هوش مصنوعی روبهرو هستند. برای دانشآموزان، این میتواند تفکر انتقادی را از بین ببرد.

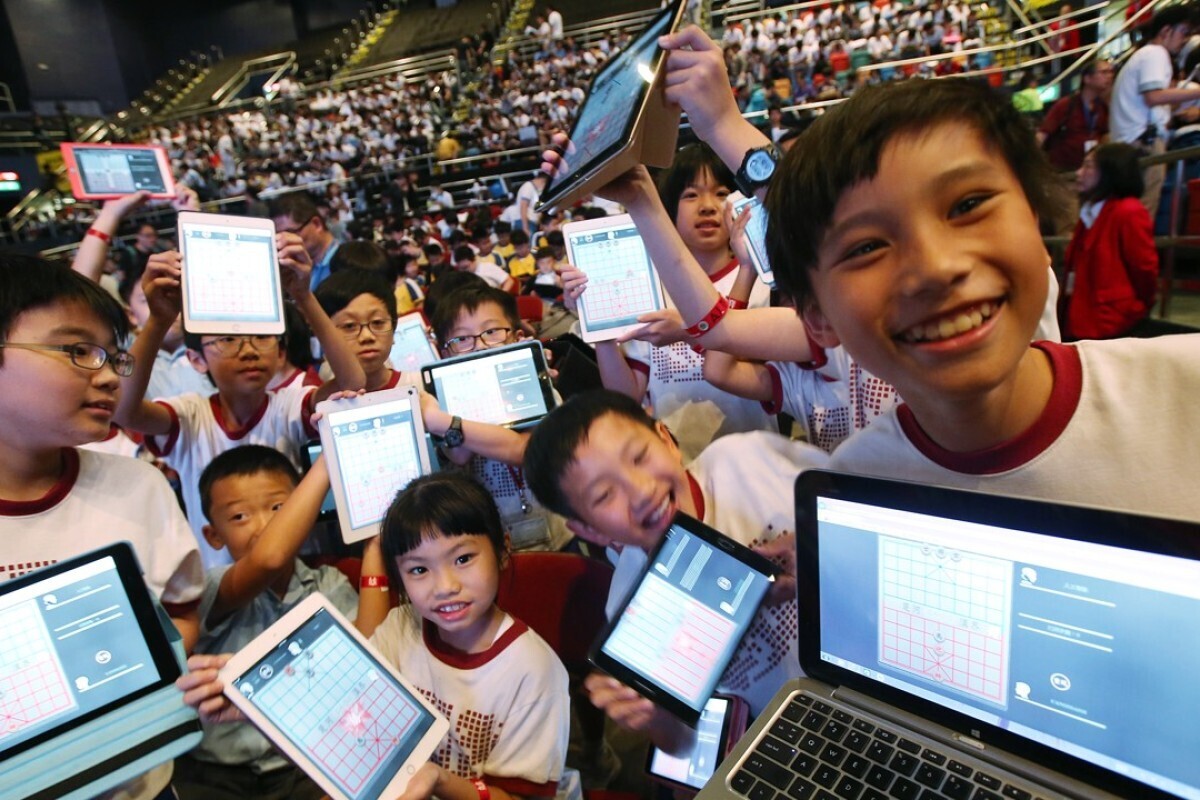

ارائهدهندگان آموزشی مانند «آکادمی خان» در حال ارائه ابزارهایی برای پشتیبانی یادگیری فردی، کمک به محافظت از دانشآموزان و افزایش تجربه برای معلمان هستند. پروژه «تایلباد گوگل» [8] در حال آزمایش یک دفترچه هوش مصنوعی است که میتواند یادداشتهای دانشآموزان را تجزیه و تحلیل کند و سپس سؤالات را توسعه دهد یا از طریق یک رابط چت، پشتیبانی آموزشی ارائه دهد. این ویژگیها به زودی در «Google Classroom» در دسترس خواهند بود و به طور بالقوه به بیش از نیمی از کلاسهای درس ایالات متحده خواهند رسید.

صرفنظر از روشهای هوش مصنوعی در کلاسهای درس استفاده میشود، وظیفه اساسی سیاستگذاران و رهبران آموزش این است که اطمینان حاصل کنند تا این فناوری در خدمت عملکرد آموزشی صحیح باشد. همانطور که «ویکی فیلیپس» [9]، مدیرعامل مرکز ملی آموزش و اقتصاد، نوشت: «ما نباید تنها به این فکر کنیم که چگونه فناوری میتواند به معلمان و دانشآموزان در بهبود کاری که اکنون انجام میدهند کمک کند، بلکه باید اطمینان حاصل کنیم که روشهای جدید آموزش و یادگیری در کنار کاربردهای هوش مصنوعی شکوفا میشوند.»

چالشها و ریسکها

در کنار این مزایای بالقوه، چالشها و خطرات دشواری نیز در زمینه استفاده از هوش مصنوعی در امر آموزش در مدارس وجود دارد که جامعه آموزشی باید از آنها عبور کند:

- تقلب دانش آموزان

دانشآموزان ممکن است از هوش مصنوعی برای حل مشکلات تکالیف یا آزمونها استفاده کنند. مقالات تولید شده توسط هوش مصنوعی تهدیدی برای تضعیف یادگیری و همچنین فرایند ورود به دانشگاه هستند. جدای از مسائل اخلاقی درگیر در مسئله تقلب، دانشآموزانی که از هوش مصنوعی برای انجام کارهای خود برای آنها استفاده میکنند، ممکن است محتوا و مهارتهای موردنیاز خود را یاد نگیرند.

- سوگیری در الگوریتمهای هوش مصنوعی

سیستمهای هوش مصنوعی از دادههایی که بر روی آنها آموزش دیدهاند، یاد میگیرند. اگر این دادهها حاوی سوگیری باشند، آن سوگیریها را میتوان توسط سیستم هوش مصنوعی یاد گرفت و تداوم بخشید. برای مثال، اگر دادهها شامل اطلاعات عملکرد دانشآموزی باشد که به یک قومیت، جنسیت یا بخش اجتماعی - اقتصادی تعصب دارد، سیستم هوش مصنوعی میتواند یاد بگیرد که از دانشآموزان آن گروه حمایت کند. سوگیریهای بالقوه در مورد ایدئولوژی سیاسی و احتمالاً حتی فلسفه تربیتی که ممکن است واکنشهایی را ایجاد کند که با ارزشهای یک جامعه همخوانی نداشته باشد، کمتر مورد اشاره قرار گرفتهاند اما همچنان مهم هستند.

- نگرانی درباره حریم خصوصی

هنگامی که دانشآموزان یا مربیان با ابزارهای مولد هوش مصنوعی تعامل دارند، مکالمات و اطلاعات شخصی آنها ممکن است ذخیره و تجزیه و تحلیل شود و حریم خصوصی آنها را به خطر بیندازد. با سیستمهای هوش مصنوعی عمومی، مربیان باید از واردکردن یا افشای جزئیات حساس درباره ارتباطات خصوصی، اطلاعات شخصی قابلشناسایی، سوابق بهداشتی، عملکرد تحصیلی، سلامت عاطفی و اطلاعات مالی در مورد خود، همکاران یا دانشآموزان خودداری کنند.

- کاهش ارتباطات اجتماعی

این خطر وجود دارد که اختصاص زمان بیشتر برای استفاده از سیستمهای هوش مصنوعی به قیمت تعامل کمتر دانشآموز با مربیان و همکلاسیها تمام شود. کودکان نیز ممکن است به جای دوستان خود به این سیستمهای هوش مصنوعی محاورهای روی بیاورند. در نتیجه، هوش مصنوعی میتواند بحران سلامت عمومی ناشی از تنهایی، انزوا و عدم ارتباط را تشدید و بدتر کند.

- تکیه بیش از حد به تکنولوژی

هم معلمان و هم دانشآموزان با خطر وابستگی بیش از حد به فناوری مبتنی بر هوش مصنوعی روبرو هستند. برای دانشآموزان، این میتواند یادگیری، بهویژه توسعه تفکر انتقادی را از بین ببرد. این چالش شامل مربیان نیز میشود. در حالی که هوش مصنوعی میتواند تولید طرح درس را تسریع کند اما سرعت با کیفیت برابری نمیکند. معلمان ممکن است وسوسه شوند که محتوای اولیه تولید شده توسط هوش مصنوعی را بپذیرند و وقت خود را برای بررسی و اصلاح آن برای افزایش ارزش آموزشی بهینه اختصاص ندهند.

- مسائل مربوط به برابری

همه دانشآموزان دسترسی برابر به ابزارهای مرتبط با رایانه و اینترنت ندارند. این عدم تعادل میتواند افزایش شکاف پیشرفت بین دانشآموزان با زمینههای مختلف اجتماعی - اقتصادی را تسریع کند.

- تأکید بر نظارت انسانی

بسیاری از این خطرات برای هوش مصنوعی جدید، منحصربهفرد نیستند. هنگامی که این دستگاهها برای اولینبار معرفی شدند، مدارس عمدتاً به دلیل نگرانیهای مربوط به تقلب، ماشینحساب و تلفن همراه را ممنوع کردند. نگرانیهای مربوط به حریم خصوصی در مورد فناوری آموزشی، قانونگذاران را به ارائه صدها لایحه در مجالس قانونگذاری ایالتی آمریکا سوق داده است. تنشهای فزایندهای نیز بین فناوریهای جدید و قوانین حریم خصوصی فدرال فعلی وجود دارد. نگرانیها در مورد سوگیری نیز قابلدرک است، اما بررسی دقیق شرایط نیز باید برای سوگیریهای نژادی یا سیاسی هم انجام شود.

با توجه به این چالشها، وزارت آموزش آمریکا بر اهمیت حفظ «انسانها در حفاظ» هنگام استفاده از هوش مصنوعی، به ویژه زمانی که خروجی ممکن است برای تصمیمگیری استفاده شود، تأکید کرده است. همانطور که این وزارتخانه در گزارش سال ۲۰۲۳ خود تشویق کرده است، معلمان، فراگیران و دیگران باید عاملیت خود را حفظ کنند. در این گزارش تأکید شده است که هوش مصنوعی نمیتواند «جایگزین یک معلم، یک سرپرست یا یک رهبر آموزشی بهعنوان متولی یادگیری دانشآموزان باشد».

چالشهای سیاستگذاری با هوش مصنوعی

سیاستگذاران با چندین سؤال مرتبط با هوش مصنوعی دست و پنجه نرم میکنند؛ زیرا به دنبال ایجاد تعادل بین حمایت از نوآوری و حفاظت از منافع عمومی هستند. سرعت نوآوری در هوش مصنوعی از درک بسیاری از سیاستگذاران پیشی گرفته است، چه برسد به توانایی آنها برای ایجاد اجماع در مورد بهترین راهها برای به حداقل رساندن آسیبهای احتمالی هوش مصنوعی در عین به حداکثر رساندن مزایا.

گزارش سال ۲۰۲۳ وزارت آموزش آمریکا خطرات و فرصتهای ناشی از هوش مصنوعی را توصیف میکند، اما توصیههای آن در بهترین حالت به راهنمایی ختم میشود. کنگره در حال تهیه پیشنویس قوانین مربوط به هوش مصنوعی است که به ایجاد بحثهای موردنیاز کمک خواهد کرد، اما مسیر رسیدن به میز رئیسجمهور برای امضا در بهترین حالت مبهم است. این به سیاستگذاران بستگی دارد که قوانین واضحتر و چارچوبی را ایجاد کنند که از مصرفکننده حمایت و اعتماد عمومی را به سیستمهای هوش مصنوعی ایجاد کند و اطمینان نظارتی را که شرکتها برای نقشه راه محصول خود نیاز دارند، فراهم کند. با در نظر گرفتن پتانسیل تأثیر هوش مصنوعی بر اقتصاد، امنیت ملی و جامعه گستردهتر، زمانی برای تلف کردن و هدردادن وجود ندارد.

چرا هوش مصنوعی متفاوت است؟

عاقلانه است که نسبت به فناوریهای جدیدی که ادعا میکنند یادگیری را متحول کردهاند، مشکوک باشیم. در گذشته، وعده داده شده بود که تلویزیون، کامپیوتر و اینترنت به نوبه خود آموزش را متحول خواهند کرد، اما متأسفانه انقلابهای اعلامشده کمتر از حد انتظار بود. با این حال، برخی نشانههای اولیه وجود دارد که نشان میدهد این موج فناوری ممکن است در مزایایی که برای دانشآموزان، معلمان و والدین به ارمغان میآورد متفاوت باشد. تکنولوژیهای قبلی دسترسی به محتوا و منابع را دموکراتیزه میکردند، اما هوش مصنوعی در حال دموکراتیزهکردن نوعی از هوش ماشینی است که میتواند برای انجام هزاران کار مورد استفاده قرار گیرد. بعلاوه، این قابلیتها، عمومی و مقرونبهصرفه هستند و تقریباً هر کسی که دسترسی به تلفن همراه و اتصال به اینترنت دارد اکنون به یک دستیار هوشمند هم دسترسی دارد. مدلهای هوش مصنوعی مولد روزبهروز قدرتمندتر میشوند و به سرعت در حال بهبود هستند. قابلیتهای این سیستمها، ماهها یا سالها بعد به مراتب بیشتر از ظرفیت فعلی آنها خواهد بود. منطقی است پیشبینی کنیم که این سیستمها در سالهای آینده قویتر، در دسترس تر و مقرونبهصرفهتر شوند؛ پس سؤال این است که چگونه میتوان از این قابلیتهای در حال ظهور به طور مسئولانه برای بهبود آموزش و یادگیری استفاده کرد.

تکنولوژی، آموزش را متحول نمیکند؛ بلکه این انسانها هستند که آن را محقق میسازند. این انسانها هستند که سیستمها و مؤسساتی را ایجاد میکنند که به کودکان آموزش میدهند و رهبران آن سیستمها هستند که تصمیم میگیرند از کدام ابزار استفاده کنند و چگونه از آنها استفاده کنند. تا زمانی که آن مؤسسات برای تطبیق با امکانات جدید این فناوریها مدرنسازی شوند، در بهترین حالت باید انتظار پیشرفتهای تدریجی را داشته باشیم. در حالی که فناوریهای گذشته انتظارات را برآورده نکردهاند، هوش مصنوعی صرفاً ادامهای از گذشته نیست؛ بلکه جهشی به عصر جدیدی از هوش ماشینی است که ما تازه در حال درک آن هستیم. در این میان، مسئولیت مداخله انسانی توسط سیاست گذاران، مربیان و والدین جهت استفاده بهینه از این فناوری به شیوهای که به طور بهینه به نفع معلمان و دانشآموزان باشد، مهم است. جاهطلبی جمعی ما نباید تنها در درجه اول بر جلوگیری از خطرات بالقوه تمرکز کند، بلکه باید چشماندازی از نقشی که هوش مصنوعی باید در آموزش و یادگیری بازی کند را بیان نماید؛ به طوری که هم از این تکنولوژی استفاده شود و هم روابط انسانی به بهترین وجه حفظ شود.

[1] . John Bailey

[2] . Neal Stephenson

[3] . Diamond Age

[4] . Sundar Pichai

[5] . Reid Hoffman

[6] . Bill Gates

[7] . Sal Kahn

[8] . Google’s Project Tailwind

[9] . Vicki Phillips

/انتهای پیام/